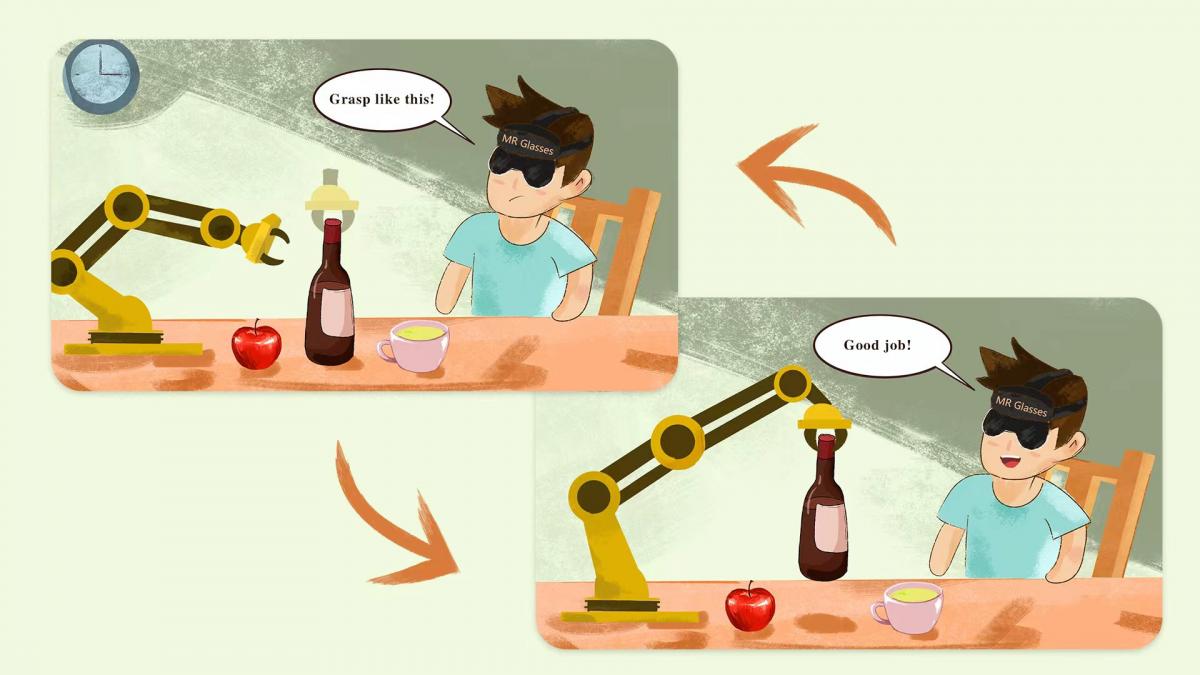

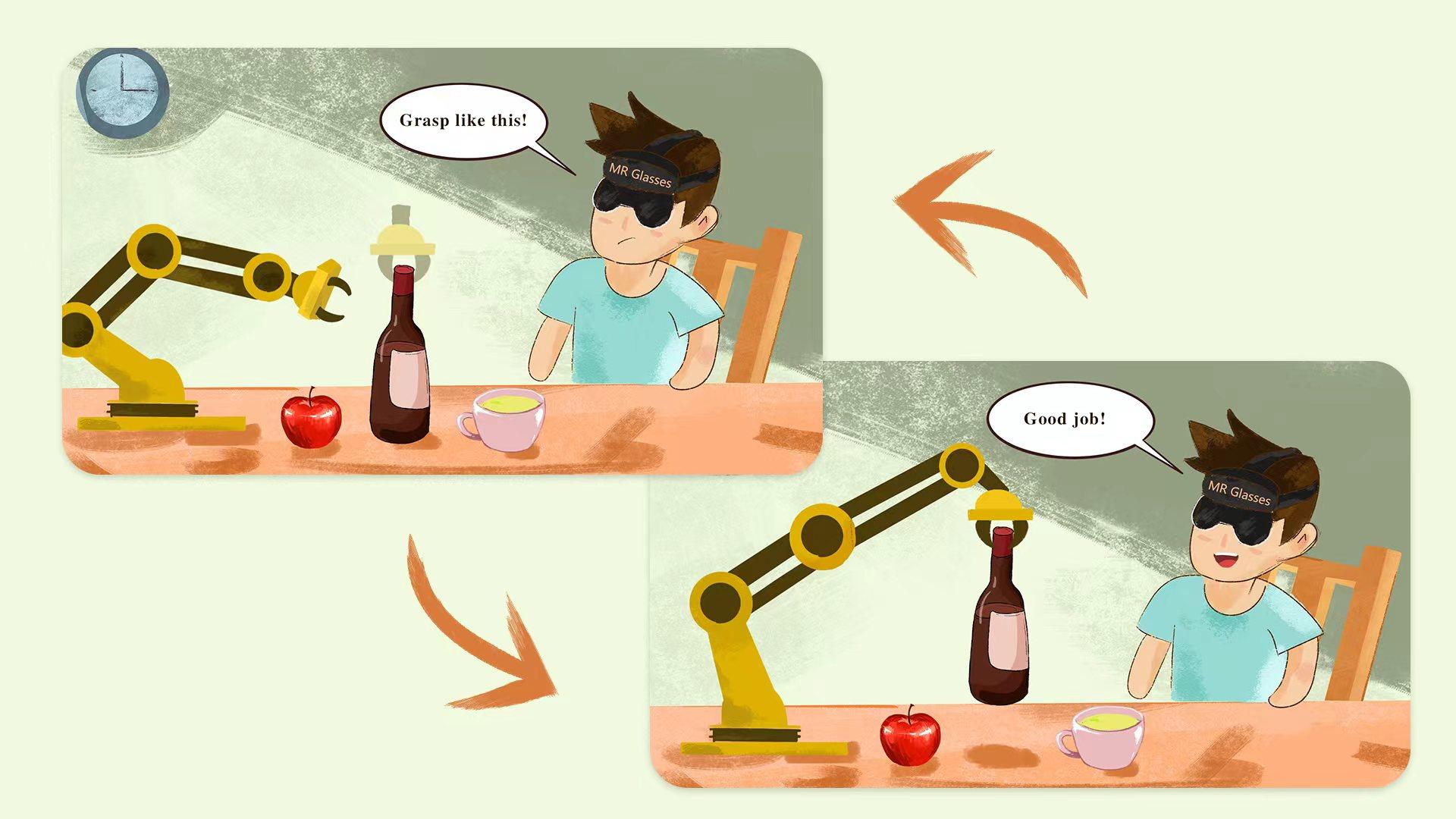

近日,南方科技大学机械与能源工程系2019级本科生张成杰以第一作者身份在机器人国际期刊IEEE Robotics and Automation Letters发表了一篇题为“An Effective Head-Based HRI for 6D Robotic Grasping Using Mixed Reality”的文章。该研究通过创新性地将头部控制和混合现实反馈结合,设计出一套人机界面,以帮助双臂残疾者有效地抓取日常生活中的物体。

在日常生活中,双臂残疾者需要在无人照看的情况下抓取物体。为了满足这一需求,一种具有潜力的思路是让机器人协助或替代这些残疾者去抓取目标物体。其中一个重要问题是如何获取人的抓取意图,并让机器人准确理解和执行。当前,许多研究通过获取人体生理信号(例如脑电、肌电等),控制机器人完成抓取任务。然而,由于人机界面信号的个体差异性和不稳定性,使得其难以控制机械臂有效地抓取日常生活中密集摆放的、大小各异、包括透明和反光的物体。

在日常生活中,双臂残疾者需要在无人照看的情况下抓取物体。为了满足这一需求,一种具有潜力的思路是让机器人协助或替代这些残疾者去抓取目标物体。其中一个重要问题是如何获取人的抓取意图,并让机器人准确理解和执行。当前,许多研究通过获取人体生理信号(例如脑电、肌电等),控制机器人完成抓取任务。然而,由于人机界面信号的个体差异性和不稳定性,使得其难以控制机械臂有效地抓取日常生活中密集摆放的、大小各异、包括透明和反光的物体。

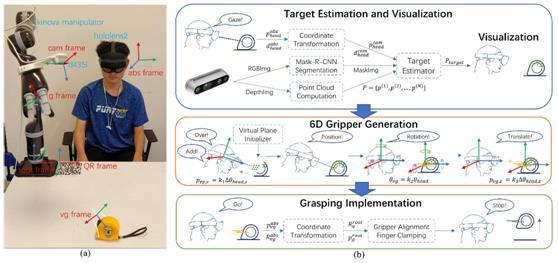

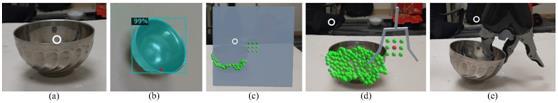

该论文通过结合头部控制和混合现实反馈,将人类的感知和决策能力引入到机器人抓取控制中,以提高机器人的抓取能力。操作者利用混合现实反馈能够看到感知结果(物体点云)以及其与真实物体的偏差。在该反馈下,操作者能够直观利用头部注视和转动来控制机械臂6D抓取位姿,从而实现对复杂物体抓取。

图1场景概况(a)+控制流程(b)

图2控制步骤图(a)-(e)

通过设计抓取实验并进行对比分析,证明了所提出的人机交互方法能更有效地抓取日常生活中的常见物体,并且具有对未知物体的抓取适应性和较高的感知误差容忍度。

张成杰为论文第一作者,机械与能源工程系教授付成龙为论文通讯作者。南科大是论文第一单位。该研究受到国家自然科学基金、深圳市科创委和广东省大学生攀登计划等项目的资助。

论文链接:https://ieeexplore.ieee.org/document/10080982

供稿:机械与能源工程系

通讯员:邓苏

主图:丘妍

编辑:朱增光